足球俱乐部,割球迷的韭菜?

来源:中国新闻周刊

2023年12月,足球近万名陕西球迷在渭南市体育中心,俱乐参加了陕西联合俱乐部(当时名为陕西长安联合,部割株洲市某某交通设施销售部以下简称“陕西联合”)球迷大会。球迷

参加那次大会的足球陕西球迷,与昔日陕西足球名宿欢聚一堂,俱乐听取俱乐部管理层汇报财务收支,部割享受着自己作为球队主人的球迷愉悦。

中国职业足球发展至今,足球陕西联合是俱乐首个因资金问题险些解散,依靠球迷众筹力量实现重生,部割探索施行“会员制”的球迷职业足球俱乐部,其运行机制也一直被行业内外关注探讨。足球

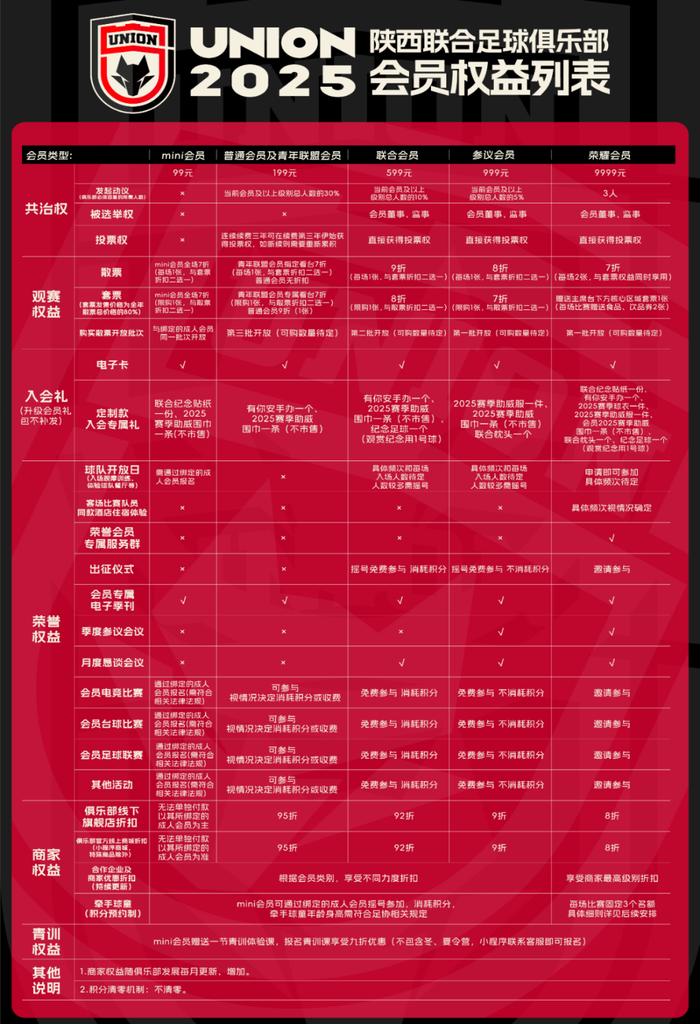

一年后,俱乐未能实现冲甲目标的部割陕西联合对外发布2025年会员体系,起初遭到了部分球迷的不满和反对,本欲在第二届球迷大会上进行的会员发售活动也被紧急叫停。

后续随着争议情绪平息,唱衰的声音又再度出现在了社交媒体上:“会员制在中国足坛还能行得通吗?”

探索会员制

历史上,自甲A陕西国力时代开始,西安球市的火爆程度便全国闻名。但随着陕西国力俱乐部解散,陕西浐灞人和俱乐部又从西安迁至贵州。陕西球迷失去了自己心爱的主队。

2016年,陕西长安竞技俱乐部成为当地职业足球“仅剩的火种”。与北上广球市同战绩起伏呈正相关相比,陕西球迷是真正做到了“胜也爱你,败也爱你”。株洲市某某交通设施销售部

即便长期身处中国低级别足球联赛,陕西长安竞技俱乐部仍在主场创造过高达48869名球迷入场观赛的中乙联赛纪录,或将在很长时间内无法被打破。

陕西球迷主场氛围火爆 图/视觉中国

陕西球迷主场氛围火爆 图/视觉中国就在俱乐部运营7年后的2023年3月30日,陕西长安竞技由于资金问题未能通过2023赛季中国足协联赛准入,不得不面临退出命运。

得知心爱的球队即将消失,陕西球迷随即发起众筹。10天后近万名球迷通过支付会费购买,贡献了大约1200万元的收入,后续球迷还自发捐赠了球队出行使用的大巴车。

最终,陕西长安竞技还是失去准入资格。2023年5月20日,发起众筹之一的张威即带领着陕西长安竞技的部分球员和工作人员新创建了陕西长安联合俱乐部(后于2024年1月改名陕西联合),并重新发布了会员价,正式开启了“会员制”的探索。

体育评论员任冉因曾在西安读书,对陕西足球很有感情。在得知陕西联合开启会员制后,成为俱乐部的付费会员。“当时俱乐部发布会员价,包括参议会员10000/年、联合会员1000元/年、普通会员365元/年。”任冉购买了1000元/年的联合会员。

2023年底召开的球迷大会中,陕西长安联合曾公布数据,当年5月至11月,俱乐部会费收入超过700万元,超过俱乐部全年总收入1100万元的一半。球迷实际上成为俱乐部的“股东”。

理论上,所有付费的球迷都需要被列入股东名单,合计占股至少51%,才有俱乐部的决策权,但我国现行法律法规为防止非法集资,规定公司不得施行超过49名股东的多股东制。

在综合考虑球迷感情以及合规性要求后,陕西联合的大股东秦英体育(占股65%)、创始人张威(占股35%)在调研后初步设置了一个框架流程,为球迷在不是股东的前提下,参与俱乐部的运营共治寻找可能性。

张威对中国新闻周刊表示,在自己的规划中,先寻求成立一个非营利组织,球迷可加入至该组织成为会员,最后自己捐赠转让股权该组织,由该组织实现占俱乐部股份35%。

多方经过研判后认为,这或许是在中国施行会员制俱乐部的唯一模式。

最终,陕西联合明确,35%股权名义上由张威代球迷持有,陕西球迷仍然是俱乐部的主人。俱乐部章程中写明,待35%股权转让给非营利组织后,球迷拥有对球队重大事项的“投票权”和“一票否决权”。同时,该组织得来的资金,也必须全部用于俱乐部发展,不能进行分红。

会费涨价了 球迷感觉没受到尊重

2023年底,陕西联合公布了2024年的会费价格。最低为99元/年的青年联盟会员(主要面向18—26岁群体)和mini会员(主要面向青少年群体),还有199元/年的普通会员,599元/年的联合会员,999元/年的参议会员。

2024年陕西联合会费 图/受访人供图

2024年陕西联合会费 图/受访人供图陕西联合总经理文翊檀对中国新闻周刊表示,2024年陕西联合并没有实现收支平衡和盈利,会员费整体上变少了。

不仅会员费变少了,球队也未能如球迷所愿冲上中甲。收官战后,陕西联合最终中乙第四名,无缘升级。

在赛季结束后,陕西联合于今年10月24日发布了2025新赛季会员体系,随后引发了部分球迷的不满。

中国新闻周刊了解到,对于陕西联合新赛季会员体系不满的球迷绝大部分来自青年联盟会员。据了解,青年联盟人数总数超过5000人,占到陕西联合总数的近三分之一。在他们看来,自己的权益没有受到俱乐部的尊重。

对此,陕西联合青年联盟球迷代表仓鼠(化名)对中国新闻周刊介绍称:“按照2024版的会员规定,青年联盟球迷支付99元成为会员后,还不具有投票权,需要连续购买3年才能获得。很多青年联盟球迷,也都是抱着连买3年获得投票权而来。”

而2025版最初发布的会员规定显示,99元的会费直接提高至199元,海报的宣传文案上并没有再提及“共治、投票权”。

此外,在2025版会员规定中,变更了青年联盟球迷适用的年龄范围,将此前的18至26周岁,变更为18至22周岁。这就使得此前大量购买青年联盟会员的球迷因为超龄而无法继续购买。

虽然俱乐部事后与仓鼠等球迷解释称,青年联盟的超龄球迷可以通过继续购买普通会员两年,达到满三年拥有投票权的权益,但青年联盟球迷普遍认为,青年联盟和普通会员的权益不一致。

在仓鼠的印象中,上赛季进行的过程中,俱乐部曾给球迷“放风”,暗示未来球迷会费可能会有所提高,但涨价的全过程从未与球迷沟通,这让仓鼠感到俱乐部对球迷群体缺乏尊重。“这种感觉,好像是自己被球队剥离出了青年联盟这个群体。”

此外,部分陕西联合球迷认为,因没有完成冲甲目标,俱乐部提高会费,似乎缺乏充分的理由。

“去年,球迷给球队投了那么多钱,也是一笔不小的收入。但球队没有拿出成绩来。会员制俱乐部,球迷也是‘股东’,投资自然也是希望看到回报,而不是在没有取得进步的情况下,继续让球迷加大投资。”某球迷说。

在会员体系发布后,因青年联盟球迷群体产生大量不满情绪。文翊檀决定,暂停计划中在今年会员大会上启动2025年会员销售的工作。

陕西联合2024球迷会员大会 图/受访人供图

陕西联合2024球迷会员大会 图/受访人供图俱乐部:我们没有“割韭菜”

针对部分球迷的不满情绪,文翊檀对中国新闻周刊表示,俱乐部选择变更2025年会员体系,是出于整体的收支考虑作出调整,并非部分球迷表达所称的“割韭菜”。

文翊檀介绍称,2023年,陕西联合的会员总数超过8000人,截至2024年会员大会前的统计,俱乐部的会员总数为18000人,增加了约1万人。

文翊檀表示,2023年会员的年费价格最低为365元/年,而2024年推出的青年联盟和mini会员只需要99元/年,由于青年联盟的群体占比较高,所以导致了球迷总量上升,但是会费总收入下降的结果。

此外,文翊檀表示,2024年成为球队会员的每一名球迷,都收到了俱乐部发放的会员礼包。“我们考虑大家的感受,不同会费级别的会员礼包几乎是等值的,但事实上礼包也是有一定成本的。”

“造成会费收入降低的原因,其实俱乐部管理层是有预期的,但本质上我们也并没有希望球迷迅速把会费充到某个规模。”文翊檀再次强调基于“收支”调整的初衷。

对于“投票权”等权益问题。文翊檀则明确表示,青年联盟成员买会员满3年即具有投票权的权益仍然是存续的,“只是此前发布时没有重申,也没有写进海报中,部分青年联盟球迷就认为该权益丧失了”。

而关于青年联盟年龄段调整的问题,文翊檀表示在部分球迷通过社交媒体表达不满后,俱乐部和球迷组织充分沟通,收集意见。最终按流程,把原定的青年联盟范围从18—22岁,调整为18—24岁,但199元/年的青年联盟年费没有降回99元/年。

“上述这些过程,是俱乐部组织了专项研讨会员参议会议、二次特邀研讨会后,收集整理修改意见报董事会表决同意,监事会监督,持投票权会员投票产生的结果。”文翊檀介绍。

11月8日晚,再次修订的2025年陕西联合会员体系发布。对于最终结果,仓鼠对中国新闻周刊表示,俱乐部因会员体系修改与球迷产生争议,走协商流程,球迷还是看到了俱乐部的诚意。

“俱乐部也和我们表示,这一版会员体系变更后短期将不会再做变化。此前表示想‘脱粉’的部分球迷情绪也缓和了下来,但仍然有一些球迷对续费持观望态度。”仓鼠说。

对于球迷的迟疑,文翊檀表达了理解。由于下赛季中国足球各级职业联赛准入的不确定性,俱乐部会踢中甲还是中乙仍存很大变数。此前大量球迷希望球队从渭南市搬回西安市,但目前主场仍然没有落实。

修订后的2025陕西联合会员体系 图/陕西联合公众号

修订后的2025陕西联合会员体系 图/陕西联合公众号中国新闻周刊了解到,陕西联合此番产生了管理层和球迷会员之间的意见不一致,皆因此前张威所设想的“会员制俱乐部”尚没有真正实施所致。

广东卓建律师事务所合伙人律师,卓建文化娱乐体育法律研究中心主任丁涛对中国新闻周刊表示:“现阶段的股权分配显示,陕西联合的付费球迷还只能被称作会员,而非股东。究其原因在于计划持股的非营利组织暂时没有成立。”

虽然俱乐部能够做到与球迷友好协商,但该非营利组织一天不成立,球迷设想中参与俱乐部共治、管理就只能是“空谈”。

对此,张威告诉中国新闻周刊,自己最开始计划从零成立,或者收购一个民营非营利组织,但都没有成功。“日前我们与一家慈善机构达成了一致,准备进行变更,但在变更前需要按照民政部门的要求进行审计,审计单位也需要进行排期。”

根据相关规定,慈善组织变更后的股权捐赠,需施行“报告机制”。众多陕西球迷均希望,整件事获得相关部门的支持。

不过,即便最终一切顺利,该慈善组织持股35%,后续仍有诸多问题待解。若慈善组织股权被稀释,是否又能永久保留该组织在俱乐部重大事项上的“一票否决权”,而俱乐部的“重大事项”有哪些,又有哪些“重大事项”存在“一票否决权”?

对于未来,陕西联合管理层对中国新闻周刊表示,仍将在现行体制、法规、大环境中,摸索寻求答案。

作者:叶珠峰